C’est encore une fête. Une Rave Party. Celle de ces jeunes en Israël. Ce festival en plein désert. Et soudain. Cette attaque. Cette fuite éperdue.

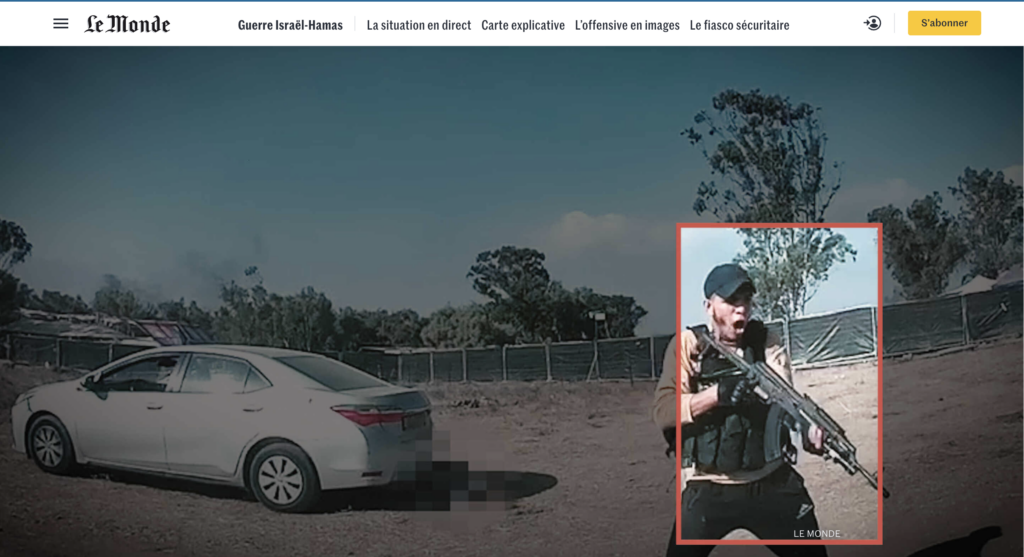

Et ces images. Celles d’enlèvement, celles de massacres, celles de corps tirés et exposés à peine morts.

Avant elles et avant eux il y avait eu d’autres images. Les terrasses à Paris. Le Bataclan aussi. Et ce 14 Juillet à Nice. Rituel attentat. A chaque fois la fête d’abord. Et soudain. Cette attaque. Ces images.

Toujours des fêtes. Toujours ce qui surgit soudain. Toujours ces images.

Ces images qui inexorablement, inlassablement, implacablement tournent dans les JT et dans les espaces numériques.

Trois appels hier de journaux, trois demandes d’interview pour comprendre ce qui cloche et pourquoi à chaque fois, dans chaque réseau et dans chaque média social, comprendre pourquoi on continue de voir des images que l’on ne devrait pas voir. Images trop crues. Trop violentes. Trop insupportables. Trop mal modérées. Trop tard retirées. Et où cela ? Sur Facebook avant-hier, sur Twitter hier encore et aujourd’hui, et sur TikTok aussi. Et demain ?

Tant qu’il y aura des guerres, du terrorisme, des tueries et des actes de barbarie nous verrons ces images. L’important n’est pas ce que nous voyons mais ce que nous comprenons de ce que nous voyons. Ce que ces images nous permettent de comprendre. Ou de nous méprendre.

Et oui bien sûr Twitter version X d’Elon Musk manque à l’ensemble de ses devoirs. Oui il n’y a jamais autant eu de discours de haine et de désinformation, et oui ils n’ont jamais été aussi visibles. Et oui la modération de Twitter / X est quantitativement une passoire, et qualitativement un blanc-seing à toutes les outrances. Et oui cela plaît au patron toXique.

Oui sur TikTok le « sludge content » s’est adapté sans mal aux images les plus dures et aux propagations de toutes les propagandes.

Comme le rappelle Clément Poursain, ici un split-screen présentant la vidéo principale (…) et en dessous

du contenu « satisfying » pour que les gens ne swipent pas.

Oui il est des rhétoriques algorithmiques de la barbarie et de la désinformation. Et il y a la banalité du mal. Et ces rhétoriques algorithmiques, incontestablement, travaillent au coeur de cette banalité du mal, elle s’y ajoutent, elles y concourent. Elles interrogent notre capacité à forger et à fonder des jugements moraux.

Changer de réseau, c’est changer de chaîne. Et souvent de morale. Chacun son réseau. Chacun ses chaînes. Chacun sa morale.

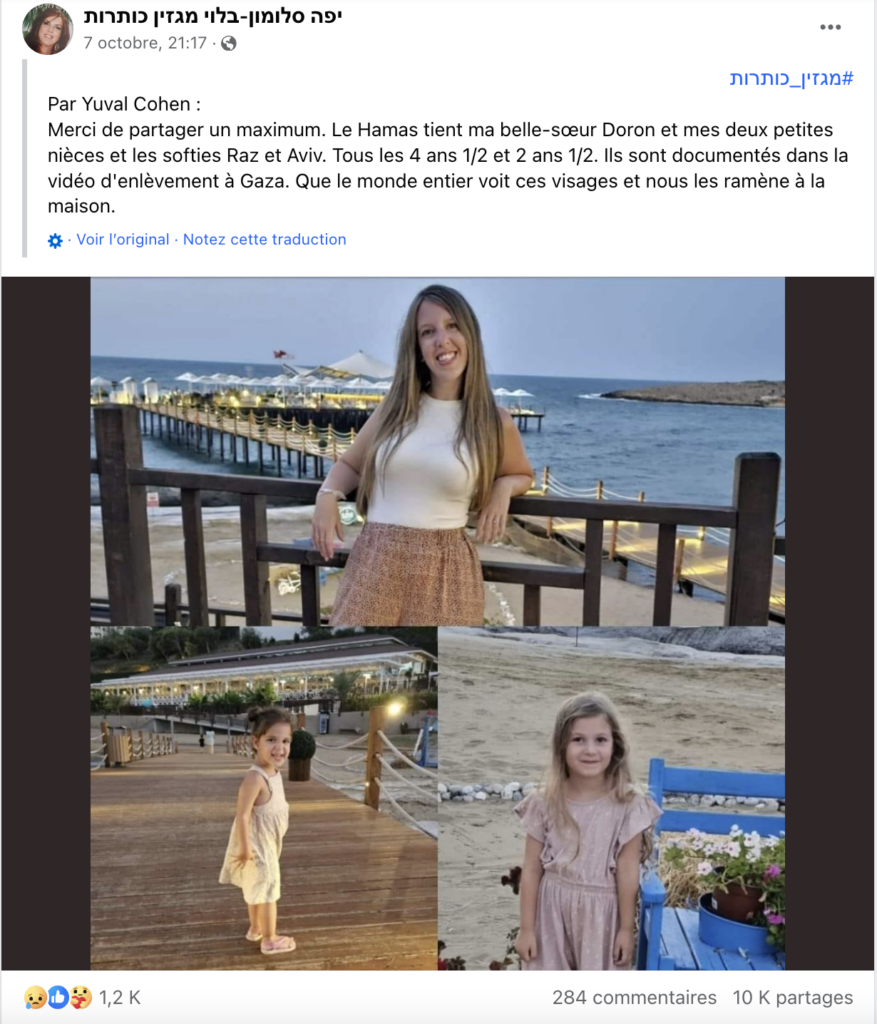

Sur Facebook mon fil est saturé d’images qui sont des portraits. Des gens cherchent leurs femmes, filles, nièces, et tant d’autres encore. La « viralité » de ces posts dit beaucoup de ce biotope informationnel particulier. De ce pourquoi il est, aujourd’hui, fait. Un livre des visages. Face Book. La guerre, les drames, la barbarie, les attentats, chaque fois, chaque fois le ramènent à ce qui est son essentiel. Sa routine propre. Des visages. Ceux des proches. Qui tout en nous étant étrangers nous deviennent étrangement proches. Chacun verra des choses différentes. A des moments différents. Venant de gens différents. Avec des intensités et des fréquences différentes. Mais tout le monde verra ces visages.

[Mise à jour 11 Octobre] Libé choisira cette famille et ces disparues pour en faire la Une de son édition du 11 Octobre.

[/Mise à jour]

Sur Twitter impossible d’échapper aux vidéos qui soulèvent et le coeur et l’âme. Ces corps exhibés et déjà entrés dans la mort, aux stigmates visibles de tout ce qu’ils ont subi. En temps réel. « Entends, Réel ». Je n’en ai vu que peu mais il ne m’en fallait pas davantage.

Le malaise, l’outrance, c’est ce sautillement et ce scintillement permanent dans lequel la plus insoutenable des vidéos ou le plus touchant des appels à l’aide alterne avec tant d’inessentiels, de divertissements, de conversations anodines.

Il faut. Il faudrait. Davantage de modérateurs et de modératrices.

Il faut. Il faudrait. Davantage de sanctions pénales et financières à l’encontre des plateformes.

Il faut. Il faudrait. Exclure et condamner pénalement les gens pris et à plusieurs reprises en flagrant délit d’appel à la haine ou de harcèlement.

Il faut. Il faudrait pour cela que la justice ait les moyens d’être rendue.

Il faut. Il faudrait. Tant de choses encore. Dont certaines d’ailleurs se mettent en place.

Mais jamais nous ne serons collectivement exempts de visionner ces images. Elles sont à la fois le prix et le miroir de nos pulsions scopiques routinières. Puisque nous avons la possibilité de tout voir, puisque nous saisissons cette possibilité dans nos quotidiens, alors il nous faut voir tout cela aussi. Et aussi difficile que cela soit à voir. Y compris dans ces replis et ces surgissements algorithmiques. Dans ces inattendus que pourtant nous ne pouvons nous empêcher de guetter, et de chercher parfois.

Le reste n’appartient pas aux images mais aux âges. Âges auxquels il est dicible d’expliquer ce qui est visible. À tous les âges nous défilons. Ou nous faisons défiler. Des images. Des visages. Swipe. A gauche ou à droite. Vers le haut ou vers le bas. Swipe. Faire défiler. Dé-filer c’est défaire ce qui pourrait être filé, tissé, et faire sens alors. Ces images défilent. Le problème n’est pas tant l’histoire qu’elles racontent que les histoires qu’elles empêchent de construire dans cet immédiat de la monstration qui est ici, une monstruosité supplémentaire.

C’est une question d’âge plutôt que d’image. Et de temps. Demain ces mêmes images documenteront, accableront, prouveront, condamneront les auteurs et les modalités de ces crimes et de cette barbarie. Aujourd’hui ces images nous sont insoutenables. Demain elles nous seront indispensables. Aujourd’hui discutables, demain indiscutables.

A force de s’interroger sur ce que nous voyons, sur ce que nous ne devrions ou n’aimerions ou ne préfèrerions pas voir, nous oublions la question du regard des autres, d’autres invisibles. Pour une image qui nous soulève le coeur, pour une vidéo qui nous retourne les tripes, il en est des centaines d’autres que nous ne verrons jamais et qui sont modérées, c’est à dire vues et regardées, au prix de traumatismes difficilement imaginables, par ces inconnu.e.s à l’autre bout de la planète. Jamais nous ne pourrons même imaginer la violence de ce qu’ils et elles ont vu pour nous protéger en nous empêchant de le voir.

Nous ne pouvons pas éviter ces images. Il n’est pas d’image qui ne soit une image sociale. Les régimes de visibilité des grands médias sociaux généralistes sont des régimes paradoxaux. Même si individuellement nous ne suivons pas les mêmes comptes, même si nous n’avons pas les mêmes centres d’intérêt, nous finirons toujours par voir les mêmes contenus à chaque fois que l’actualité internationale, ou un fait divers, ou les interêts propres de la plateforme, l’auront décidé. Et lorsque plusieurs de ces paramètres convergent, comme c’est le cas à chaque attentat, guerre ou tuerie, alors il n’est plus aucun moyen de se soustraire à ces dynamiques de monstration.

Nous pouvons à peine négocier ces images. Avec nos choix de les repartager ou non, de les faire circuler ou pas, de les « liker » ou non, de les ajouter en favoris ou pas, mais aussi avec le temps que nous passons à nous arrêter dessus ou à relancer la lecture d’une vidéo, de suivre ou de ne plus suivre les comptes qui les diffusent … chaque interaction est une négociation avec les régimes algorithmiques de visibilité à l’oeuvre sur la plateforme. Ces négociations reposaient avant sur des collectifs professionnels organisés, structurés, que l’on pouvait interpeller, et qui devaient répondre de leurs choix et de leurs stratégies éditoriales. Les médias sociaux ont fragmenté et individualisé à outrance ces espaces de négociations. Mais il demeure des espaces instrumentaux de négociation. Dont nous n’avons pas d’autre choix que de nous saisir.

« On ne négocie pas avec les terroristes. » Mais on négocie constamment avec les images du terrorisme.

Au-delà de l’horreur et dans une tentative maladroite pour l’oublier, je prends FB au mot et note la traduction de la 3ème publication : 4 sur 10. L’algorithme ne connait pas le subjonctif présent (mais le programmateur non plus probablement) et insère du globish qui n’a aucun sens. Il y a vraiment du boulot à faire à tous les étages chez Meta.

Quant aux images, il est possible de ne pas les voir, mais il faut le choisir. C’est plus difficile pour ceux qui travaillent dans l’info et la comm’, bien sûr. Je pense à Orwell, qui jugeait toute avancée technologique en se demandant si elle le rendait plus ou moins humain. On a la réponse.

Il est illusoire d’espérer changer la philosophie et le fonctionnement des plateformes. C’est votre côté de gauche, vous croyez beaucoup trop en l’humain.

Triste monde si plus personne ne croit en l’être humain. Autant se tirer une balle tout de suite.