Plus dure Durov sera la chute.

Le monde (numérique) se divise en 2 catégories. Ceux qui ont un pistolet chargé pensent que la liberté d’expression doit y être totale, et ceux qui creusent pensent qu’elle doit y être encadrée comme dans tout espace public.

L’occasion de l’arrestation de Pavel Durov (aussi orthographié Dourov), patron du réseau social Telegram, soulève une infinité de questions passionnantes dans le contexte politique actuel de nos usages et environnements numériques.

Nota-Bene : Pavel Durov avait été naturalisé Français par Emmanuel Macron en 2021 au titre,explique-t-il aujourd’hui, de son apport à la start-up nation et de son parcours d’excellence.

A date de parution de cet article (4 septembre 2024), et comme indiqué dans Le Parisien, « Pavel Durov a été remis en liberté et astreint à un contrôle judiciaire lourd avec obligation de remettre un cautionnement de cinq millions d’euros, un pointage deux fois par semaine dans un commissariat et l’interdiction de quitter le territoire français. »

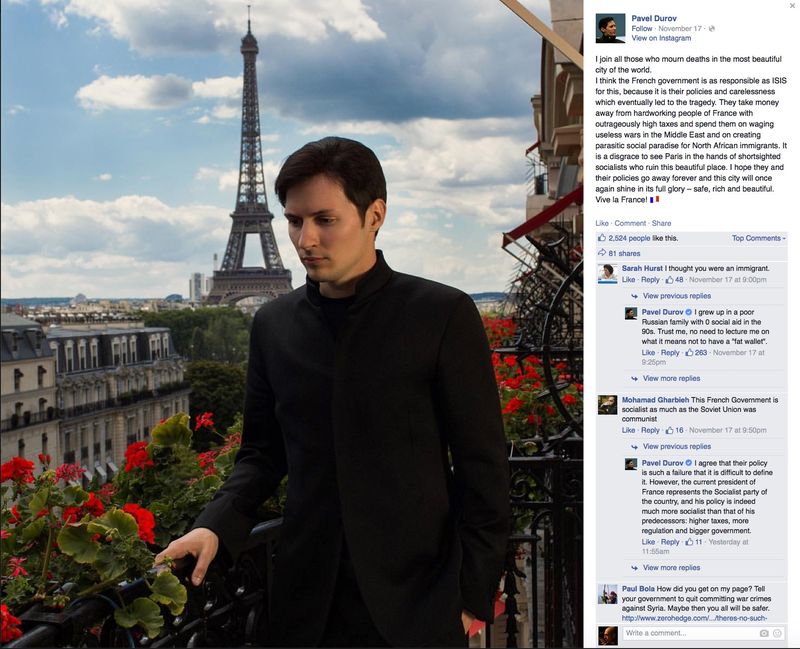

La première fois que j’ai croisé Pavel Durov et vous en avais parlé sur ce blog, c’était il y a presque 10 ans, en 2015, juste après les attentats du 13 Novembre, à l’occasion du focus qui avait alors été fait sur l’application Telegram qui avait été utilisée par de nombreux Djihadistes et suite à la réaction de Pavel Durov, promettant qu’il allait y faire un peu de ménage tout en multipliant les déclarations lunaires au sujet de ces attentats.

Screen de son compte Instagram, 5 jours après les attentats il écrivait : « (…) la responsabilité de ces attentats incombe autant à ISIS qu’au gouvernement français (sic), parce que ce sont leurs règles et leur manque d’attention qui ont pu éventuellement conduire à cette tragédie. Ils prennent de l’argent aux personnes qui travaillent dur à l’aide de taxes et d’impôts outrageusement élevés et vont dépenser cet argent pour mener des guerres inutiles au Moyen-Orient et en créant un paradis social parasite pour les immigrants d’Afrique du Nord (sic). »

Lorsque l’on a du mal à déterminer si un individu est un salaud, un bienfaiteur de l’humanité ou juste un dingue (la citation ci-dessus comporte quand même plusieurs indices), il arrive, pour nous aider à trancher cette question, que l’on regarde dans quelle catégorie se rangent celles et ceux qui le soutiennent. Dans le cas d’espèce cela nous mème à une autre impasse puisque Pavel Durov est aussi bien soutenu par d’authentiques salopards (d’Elon Musk à Vladimir Poutine en passant par la totalité de l’extrême-droite la plus sordide) que par des bienfaiteurs de l’humanité au premier rang desquels Edward Snowden (en passant aussi par Bluetouff et tout un tas d’autres) On peut aussi regarder comment il traite ses enfants : Durov est accusé de « violences graves » sur un de ses enfants.

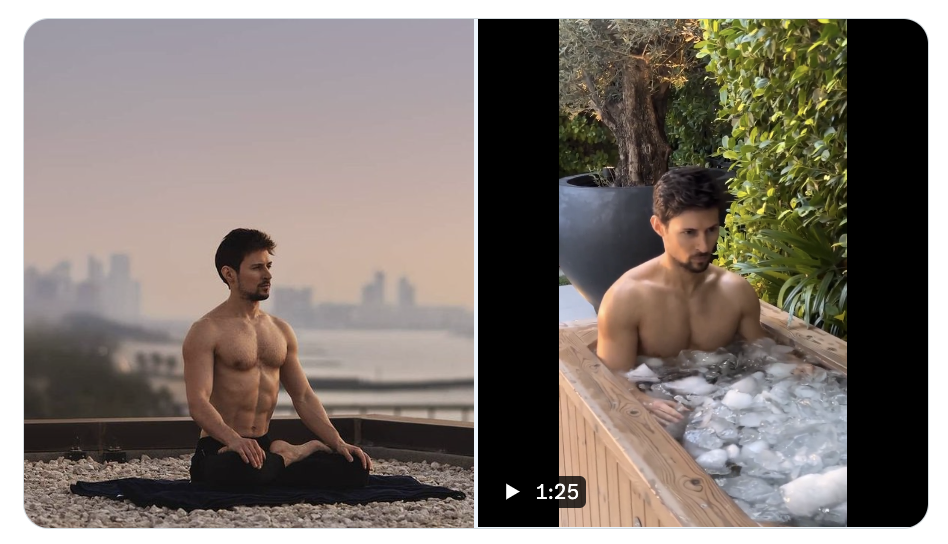

On peut également faire un saut du côté de son image médiatique, et celle de Pavel Durov s’inscrit dans la mythologie moderne du « génie » de la finance et du marketing autant que de l’informatique (en fait c’est surtout son frère Nikolaï, cryptographe de formation, qui a développé le coeur du réacteur de Télégram), et affiche un personnage public assez fan de sa propre mise en scène, adepte de la méditation (parce que c’est cool), de la cryothérapie (parce que c’est Soooo Fresh et qu’il a un corps d’athlète à conserver éternellement jeune), du biohacking (toujours ce rapport au corps), d’un hygiénisme extrême, de l’idéologie libertarienne et des idées d’extrême-droite. Dans mon échelle personnelle de valeurs, cela le range plutôt sous le signe astrologique des gens dangereux avec un ascendant connard probable, mais j’entends et comprends parfaitement que cela puisse représenter un modèle enviable ou littéralement admirable pour d’autres.

Bon il est quand même gaulé.

(image extraite de ce thread éclairant sur d’autres aspects chelous de sa personnalité)

Dans la catégorie « salopards », on m’objectera que Dourov s’est tout de même illustré par son opposition au régime de Poutine, refusant, pour Telegram comme pour VKontakt (équivalent russe de Facebook qu’il avait créé avant Telegram) de livrer au régime les clés de ces plateformes ou des informations sur les discours que les opposants y tenaient. Une position qui pourrait plutôt lui créditer de la sympathie mais qui n’est en rien liée à un positionnement d’opposant politique et tient uniquement à sa vision « radicale » de la liberté d’expression et de sa conviction sur les questions de « privacy ».

Telegram est aujourd’hui en Russie l’un des rares espaces numériques à échapper (en partie) à une censure systématique ou en tout cas à une main-mise totale du régime, et le fait qu’il soit également massivement utilisé par des militaires, tant du côté Russe qu’Ukrainien, confère à cette arrestation dans le contexte géopolitique actuel une résonance très particulière pour les belligérants comme pour leurs alliés.

Si l’arrestation de Durov est intéressante, c’est parce que dans son objet, elle réveille tout un pan d’une question historique tout aussi absolument fondamentale que jamais réellement tranchée de la culture web : la question de la responsabilité éditoriale des « intermédiaires » (hébergeurs, fournisseurs de services, opérateurs télécom).

Et si l’arrestation de Durov est tout autant intéressante, c’est parce que dans son sujet, elle pose la question de la place politique et géopolitique de ces plateformes, a fortiori dans un contexte où c’est la France, pays des droits de l’homme et de la liberté d’expression (officiellement en tout cas), qui arrête un exfiltré d’une dictature (la Russie), laquelle dictature s’émeut d’une atteinte à la liberté d’expression (et de circulation) ; et où l’ensemble des défenseurs de l’ensemble des versions et gradations de la liberté d’expression, de la plus maximaliste à la plus minimaliste, prennent des positions semblables, expliquant pour les uns (Musk, Poutine et le camp d’extrême-droite en général) que « c’est bien la preuve qu’en fait les méchants états soi-disant démocratiques veulent tout savoir de ce qu’on dit dans nos échanges privés et mettre tout le monde sous surveillance et que la liberté d’expression est menacée« , et pour les autres (Snowden et la plupart des militants gauchistes des libertés numériques) que « c’est bien la preuve qu’en fait les méchants états soi-disant démocratiques veulent tout savoir de ce qu’on dit dans nos échanges privés et mettre tout le monde sous surveillance et que la liberté d’expression est menacée« .

Et oui. Lorsque Musk et Snowden parviennent au même constat, lorsque Poutine et Trump s’alignent sur la même analyse, lorsque des militants des libertés numériques soucieux du rôle d’un état régulateur et respectueux du secret des correspondances, et des libertariens porteurs d’une conception maximaliste de la liberté d’expression arrivent au même constat, nous avons, collectivement, un putain de problème.

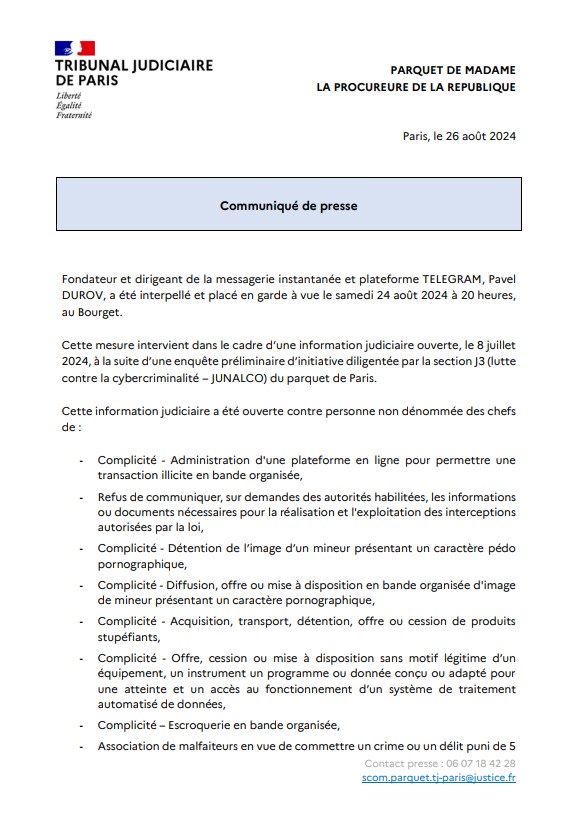

Prenons d’abord l’angle de la responsabilité éditoriale des intermédiaires. Ce qui est reproché à Pavel Durov et motive son arrestation sur le territoire Français, c’est tout à la fois d’avoir laissé prospérer différents types de discours de haine et d’activités illégales sur sa plateforme, et, surtout semble-t-il, de ne pas avoir répondu aux demandes de collaboration de l’état Français pour obtenir des informations sur ces discours ou activités et/ou pour y mettre un terme.

Voici les éléments complets du communiqué de presse de la procureure saisie de l’affaire.

Cette question, celle de la responsabilité de Durov sur les points listés ci-dessus, est une question « historique » car pour des gens qui, comme moi, sont plus vieux que ne l’est le Web, elle se pose pour la première fois en France en 1999 lorsqu’Estelle Hallyday attaque et fait condamner en justice un hébergeur, Altern.org, pour avoir diffusé des photos d’elle nue parues dans la presse, comprendre en réalité : pour avoir hébergé des pages personnelles sur lesquelles on trouvait ces photos (pour être tout à fait exact elle commence en vérité, dès 1996 avec pour la première fois un hébergeur poursuivi en justice suite à la circulation de photos pédocriminelles mais c’est l’affaire Hallyday qui va faire de cette question aussi éthique que technique un authentique sujet de société).

A l’époque (je vous fais la version courte), l’hébergeur (Valentin Lacambre) est en effet condamné en justice, essentiellement pour faire un exemple et donner le ton d’une politique qui consista longtemps à présenter le web comme un « far-west » (ce qu’il ne fut jamais) et à en criminaliser les pratiques (liées au partage et à la copie) jusqu’à la loi Hadopi qui est encore aujourd’hui un parangon de bêtise et d’inutilité. Si cette histoire ne vous est pas familière, prenez 10 minutes pour regarder le passage du formidable documentaire « Une contre-histoire de l’internet », de la 24ème à la 32ème minute.

Aujourd’hui, toujours pour faire très court et très simple, nous avons en France différentes lois (LCEN de 2004 notamment) au titre desquelles les intermédiaires de l’Internet peuvent être considérés comme responsables des contenus qu’ils diffusent ; mais leur responsabilité ne pourra être engagée que s’ils ont une connaissance effective de l’activité ou de l’information illicite ou, dès lors qu’ils en prennent connaissance, ne la retirent pas promptement ou n’en rendent pas l’accès impossible. Aux USA, l’affaire est encadrée par ce que l’on appelle la section 230 du Communications Decency Act (1996), un texte de loi qui, à l’inverse, dispense les plateformes, sites et forums en ligne de leur responsabilité pour les contenus qu’ils hébergent, sauf s’ils leur ont été signalés comme illicites (« Aucun fournisseur ou utilisateur d’un service informatique interactif ne doit être traité comme l’éditeur ou l’orateur d’une information fournie par un autre fournisseur de contenu d’information« ).

Ce qui est paradoxal aux USA c’est que cette section 230 a tout à la fois été combattue et défendue, souvent par les mêmes, mais pour des raisons totalement opposées. Ainsi Donald Trump a commencé par s’en servir pour défendre toutes celles et ceux de ses partisans (et lui-même) qui s’abritaient derrière pour raconter les pires saloperies et autres Fake News, puis une fois les limites franchies et voyant la menace de sa « déplateformisation » devenir presqu’inéluctable, voulut cette fois carrément l’abroger en accusant les plateformes (Twitter essentiellement) d’intervenir en signalant certains contenus comme possiblement faux ou mensongers et donc en faisait un peu de fact-checking ; or la section 230 ne « protège » plus les plateformes à partir du moment où elles interviennent éditorialement sur les contenus.

Ce que cette histoire nous apprend c’est que la question de la responsabilité éditoriale des plateformes, grosso modo, s’arbitre différemment entre l’Europe et les USA, mais que déjà et y compris dans les législations les plus « permissives » ou « maximalistes » (aux USA donc) un même texte peut-être utilisé pour étendre ou pour limiter ladite responsabilité. Ou pour le dire différemment : les lois sont d’affaire et de portée générale mais la justice ne traite que de cas particuliers.

L’autre enseignement de ce court rappel historique, c’est que quelle que soit la période concernée, quel que soit le nombre d’internautes (quelques centaines de milliers dans le monde ou plusieurs milliards), indépendamment des stades technologiques et de l’évolution des plateformes du web (des forums aux médias sociaux en passant par les blogs et les pages personnelles), la question de la manière d’arbitrer entre le statut d’éditeur et celui d’hébergeur a toujours été très simple à poser et extrêmement complexe à régler. Et s’il demeure des invariants entre un Pavel Durov propriétaire de Telegram et son presque milliard d’utilisateurs et Jean-Jacques Michu, propriétaire de la page « j’aime la biscotte » et de son forum de 200 utilisateurs, il est délicat de mettre sous silence les effets d’échelle.

Dark Social.

Historiquement, la question de la différence entre hébergeur et éditeur est venue percuter tous les acteurs de l’économie documentaire du web. D’abord les opérateurs télécom et les fournisseurs d’accès (au titre des forums et pages personnelles qu’ils hébergeaient), ensuite les moteurs de recherche, puis les réseaux et médias sociaux, et enfin ce que l’on nomma les plateformes relevant du Dark Social c’est à dire des outils et plateformes initialement bâties sur des fonctionnalités de messageries, fonctionnalités rapidement étendues pour intégrer l’équivalent de médias et réseaux sociaux (et la publicitarisation qui l’accompagne). Et à ce titre en effet Telegram est l’un de ces bastions du Dark Social qui est à la fois le plus emblématique et le plus utilisé dans tous types de contextes et de pays.

Le problème Telegram est un problème à trois corps

(ou à trois étages).

Le premier étage est « législatif et juridique » : c’est d’abord celui de l’existence d’espaces numériques totalement imperscrutables, imperquisitionnables, y compris par la justice et dans le cadre de procédures de droit (au regard de la législation des pays ou de l’espace dans lequel ces espaces sont déployés). De tels espaces sont-ils simplement tolérables ? Ou si je reformule, est-il tolérable que qui que ce soit puisse disposer d’un espace numérique, de stockage, de partage ou d’échange, qui soit par nature comme par fonction totalement exclu de la capacité d’agir et de perquisitionner d’un juge ? On est plutôt tenté de répondre par la négative. Si les besoins d’une enquête le nécessitent, un juge doit pouvoir disposer des éléments de preuve possiblement rassemblés dans de tels espaces, ce qui implique que leur niveau de chiffrement puisse être levé, dans certaines conditions bien définies. Ce qui nous mène au second étage. En notant au passage que les modalités de recueil de la preuve répondent, en droit, à un principe dit de « loyauté de la preuve » que je vous expliquais dans cet article et que l’on retrouve dans le communiqué de presse du parquet dans l’interpellation de Dourov lorsqu’il évoque « l’exploitation des interceptions autorisées par la loi. »

Si ces questions juridiques vous intéressent, je vous conseille la lecture (entre autres) de l’article de Jérôme Houdeaux sur Mediapart qui en dresse à la fois les ambitions, le cadre et les limites. Par exemple ceci :

Les enquêteurs ont (…) la possibilité de demander aux opérateurs l’accès aux contenus des messages. « Les interceptions de correspondances sont autorisées dans le cadre de l’instruction préparatoire ou durant l’enquête judiciaire mais uniquement pour la délinquance et la criminalité organisées, précise Jérôme Bossan. Et la jurisprudence reconnaît depuis 2015 que l’interception des correspondances peut viser les messageries instantanées. »

« Une deuxième technique se développe, ajoute le juriste, l’accès à distance aux données de correspondances stockées dans un appareil. Dans ce cas, on n’accède plus aux échanges à venir, mais également à ceux passés, stockés dans l’ordinateur ou le téléphone. L’atteinte à la vie privée est donc encore plus grande. C’est une technique qui est réservée aux crimes et elle doit être autorisée par le juge des libertés et de la détention. »

Ce premier étage législatif et juridique est aussi une histoire de taille et de nombre d’utilisateurs. Comme révélé dans le Financial Times et repris par Jean-Marc Manach dans NeXt :

« La Commission européenne soupçonne Telegram d’avoir sous-estimé sa présence dans l’UE afin de rester sous le seuil des 45 millions d’utilisateurs (soit 10 % de la population de l’UE) fixé dans le Digital Services Act (…). Au-delà, les « très grandes plateformes en ligne » (very large online platforms, ou VLOP) sont en effet soumises à une série de réglementations destinées à contrôler leur influence. »

Second étage qui est donc plus « technique » et relève de ce que l’on met derrière le « chiffrement » et la sécurisation des communications. Même si l’histoire des techniques (et de la cryptographie) nous apprend qu’il n’est aucun code ou chiffrement qui ne puisse finir par être brisé, l’une des questions est celle du niveau de chiffrement déployé par défaut pour telle ou telle plateforme dédiée à tel(s) ou tel(s) usage(s), et du temps et des moyens potentiellement nécessaires pour en venir à bout. On parle beaucoup de « chiffrement pas défaut », de « chiffrement de bout en bout » et l’on raconte souvent à ce sujet pas mal de bêtises. Moi-même n’étant pas spécialiste du sujet, je peux juste vous indiquer que contrairement à ce que l’on lit un peu partout, Telegram n’est pas une application chiffrée de bout en bout (côté émetteur et côté récepteur) et que son niveau de « sécurité » et de confidentialité est somme toute assez relatif, et qu’une partie des échanges visés par la décision judiciaire menant à l’arrestation de Durov concerne des canaux Telegram « publics ». Cet étage technique pose la question suivante : en admettant qu’un hébergeur de service crypté ou chiffré dispose d’un moyen de casser ledit cryptage ou chiffrement, le fait qu’il remette ce moyen à un juge dans le cadre d’une enquête fait-il peser une menace sur l’ensemble des utilisateurs du service qui pourraient, au moyen de la même « clé » livrée à un juge (une « backdoor »), voir l’ensemble de leurs échanges sous la menace d’une intrusion (la technique de « dé »chiffrement pouvant potentiellement être utilisée en dehors de toute procédure judiciaire. Cette histoire est tout sauf inédite et ressemble très exactement à celle qui s’est produite lors de l’affaire dite « Apple VS FBI » dans laquelle Apple refusait de donner au FBI les moyens de casser le code d’un iPhone utilisé dans le cadre d’un attentat terroriste, au motif que si une telle clé de déchiffrement existait (et qu’elle était remise à la justice), c’est l’ensemble des utilisateurs des appareils de la marque à la pomme qui se trouveraient ainsi « menacés » et la promesse (technique et marketing) d’une « vie privée préservée » sérieusement dégradée. Cette histoire j’en avais fait plusieurs articles à l’époque auxquels je vous renvoie si vous le souhaitez, notamment « Un terroriste est un client Apple comme les autres » (Février 2016) et « Un pédophile est un client Apple comme les autres » (Janvier 2020)

Et le troisième étage est « éthique » et renvoie à la conception que chacun (comme individu, comme collectif ou comme état) peut avoir de ce que les anglo-saxons appellent la « privacy » et que le terme de « vie privée » ne retranscrit que très imparfaitement. La « bonne » définition de la privacy, celle en tout cas qui pour le sujet de cet article me semble être la voie vers laquelle il faut tendre, est celle qui fut énoncée à la fin du 19ème siècle, c’est à dire à la fois un « principe de non-nuisance » et un « droit d’être laissé tranquille » (Casilli, 2014), y compris lorsque nous « emmenons », lorsque nous « embarquons » dans l’espace public des informations relevant de la sphère privée.

Ce qui est public.

La question de la « responsabilité éditoriale » de plateformes massives construites principalement autour de fonctionnalités assimilables à des messageries privées est totalement insoluble au regard de l’autre question fondamentale en démocratie qui est celle du respect du secret de la correspondance. « Responsabilité éditoriale » et « secret de la correspondance » fonctionnent comme une aporie :

- si la correspondance est réellement secrète (et il est souhaitable qu’elle le soit et le demeure, sauf dans certains cadres prévus par la loi) alors les plateformes ne peuvent avoir de responsabilité éditoriale que si un tiers (l’état, un juge, un hacker …) casse ce secret et le dévoile en le mettant dans l’espace public.

- à l’inverse, pour que la responsabilité éditoriale des plateformes soit engagée a priori comme a posteriori, il faut considérer qu’elles disposent des moyens de casser le secret de la correspondance, c’est à dire qu’elles aient ce que l’on appelle des « backdoors ». Et cela nous ramène à l’affaire Apple VS FBI dont je vous parlais plus haut.

La question est donc toujours fondamentalement de savoir ce qu’est un espace public (puisqu’il concentre dans la plateforme elle-même tout autant que dans plusieurs de ses canaux des milliers et jusqu’à des dizaines de milliers ou de millions d’individus dans un même « espace » numérique) qui revendique d’être construit sur l’établissement d’échanges privés (relavant donc du secret de la correspondance).

L’affaire Durov (et bien d’autres avant elle) atteste que la promesse marketing d’espaces numériques massifs articulant une dimension d’expression publique et des modalités de correspondances privées est une aporie philosophique et technique, et la source d’une inquiétude démocratique légitime.

La solution est pourtant aussi simple que le problème apparaît complexe mais elle implique un renoncement. Depuis que les réseaux sociaux existent (ils n’intégraient alors pas du tout ou très marginalement la dimension « média »), et depuis qu’ils sont devenus des « médias sociaux », ils entretiennent une confusion entre espace public et espace privé. Confusion d’abord nativement et naïvement structurelle puis très rapidement instrumentalisée à des fins de publicitarisation et d’assignation attentionnelle. La chercheuse danah boyd expliquait dès 2007 les mécanismes de ces espaces perçus comme semi-publics (ou semi-privés). Elle écrivait :

« Un site de réseau social est une catégorie de site web avec des profils d’utilisateurs, des commentaires publics semi-persistants sur chaque profil, et un réseau social public naviguable (« traversable ») affiché en lien direct avec chaque profil individuel. » (danah boyd) »

Et elle ajoutait dans cet article (.pdf), 4 paramètres contribuant particulièrement à la confusion entre espace public et espace privé :

-

- la persistance : ce que vous dîtes à 15 ans sera encore accessible quand vous en aurez 30 …

- la « searchability » (littéralement, capacité à être recherche/retrouvé) : « avant les réseaux sociaux, votre mère ne pouvait pas savoir où vous étiez en train de faire la fête avec vos amis ou ce que vous pensiez d’elle. Maintenant … c’est possible.«

- la « reproductibilité » : ce que vous avez dit/publié/posté/photographié/filmé peut être recopié et replacé dans un univers de discours totalement différent.

- les « audiences invisibles » : la médiation particulière que constituent ces réseaux sociaux et la conjugaison des trois critères précédemment cités fait que la majorité des publics/destinataires est absente au moment même de la médiation (= la transmission du message), créant ainsi un effet non pas simplement de voyeurisme mais une temporalité numérique particulière.

Nous partîmes 500 et par un prompt renfort …

La solution est aujourd’hui comptable. Et le problème est numérique. Considérer qu’un espace de socialisation réunissant plusieurs centaines de milliers, ou millions ou milliards d’utilisateurs, traversé par une publicitarisation constante, alimenté organiquement de médias et disposant d’une éditorialisation algorithmique, considérer que cela est un espace « semi-privé » est une aporie, une folie, une aberration.

De la même manière considérer qu’un espace dans lequel on s’inscrit, dans lequel on dépose délibérément un ensemble de données personnelles, qui se sert de chaque interaction pour dresser un portrait de nous en data et qui historicise l’ensemble de nos interrelations sociales ou parasociales à des fins de monétisation, considérer que cela est un espace « public » est un autre aporie, une autre folie, une autre aberration.

Il faut séparer l’homme de l’artiste la plateforme (spoiler : non).

La question, la seule valable, c’est celle du pouvoir d’un seul individu sur un média capable de toucher des centaines de millions (parfois de milliards) d’autres instantanément. C’est une question valable pour Pavel Durov mais qui l’est aussi pour Zuckerberg, pour Musk et, dans une moindre mesure pour Bolloré et les autres milliardaires patrons de médias (dans une moindre mesure car même si les enjeux politiques y sont aussi problématiques et mortifères pour la démocratie, les éditorialisations y sont plus lisibles et organisées et parviennent encore un peu à s’y tenir comme autant de possibles contre-pouvoirs – en termes plus clairs il existe ou subsiste des rédactions dont toutes n’opèrent pas uniquement par auto-censure).

J’avais dans un long article qui me semble (pardon pour l’immodestie) assez important, expliqué pourquoi ouvrir le code des algorithmes ne suffirait désormais plus et pourquoi il fallait réfléchir (de manière complémentaire) à d’autres échelles. Voici les trois principaux arguments qui j’y déployais (parution initiale sur AOC et republication sur Affordance) :

Primo. « Le problème de Twitter / X aujourd’hui, comme celui de Facebook, d’Instagram, de TikTok, de Snapchat et d’autres plateformes numériques n’est plus réductible à la seule question de leurs déterminismes algorithmiques. Il doit être réfléchi à la hauteur de l’ensemble de ce que j’appelle leurs architectures techniques toxiques, c’est à dire en partie, mais en partie seulement, la question algorithmique ; mais également le maillage de ces espaces d’expression avec d’autres espaces sociaux et médiatiques et la manière dont ils s’entremêlent ; mais aussi avec l’ensemble des secteurs dans lesquels ces plateformes opèrent (qui pour la majorité d’entre elles sont loin d’être réductibles au seul secteur de la tech) avec tout l’impact et les influences économiques et politiques que cela mobilise ; et enfin en regardant ces plateformes et médias comme la partie visible d’infrastructures extractivistes bien plus vastes et plus massives dans lesquelles le “média social” constitue de plus en plus une forme de leurre stratégique qui tend à gommer ou à dissimuler les matrices de pouvoir dont elles se nourrissent et qu’elles orchestrent. »

Deuxio. « Derrière les algorithmes, ces plateformes posent aujourd’hui la question de leur place dans un espace public médiatique démocratique. Ô bien sûr pas de manière totalement inédite. De William Randolph Hearst à Vincent Bolloré, la mainmise sur des médias au service de la fabrique d’une opinion alignée sur la ligne idéologique de leurs propriétaires (et/ou jouant sur les plus viles pulsions de son audience) n’a rien de nouveau. Mais la nature si particulière de notre rapport aux médias numériques vient d’une réalité simple : si nous voulons lutter contre Bolloré nous pouvons regarder ou ne pas regarder, acheter ou ne pas acheter, écouter ou ne pas écouter. Notre choix reste binaire parce qu’à aucun moment nous n’envisageons la possibilité de négocier avec lui. A l’échelle des médias sociaux, nos expressions publiques comme privées sont en permanence situées dans des espaces troubles de négociation qui sont eux-mêmes traversés de saillances le plus souvent imprévisibles. Nous sommes par exemple aussi surpris de la viralité soudaine d’un de nos posts que nous n’imaginions même pas, que nous sommes déçus de l’absence de réaction conforme à nos attentes sur un autre post que nous pensions devoir mériter d’être mieux exposé. »

Tertio. « Dès lors qu’un média social est lisible dans ses intentions, dès qu’il se dote d’une ligne éditoriale, la question de l’importance d’avoir accès au code source de son algorithme change d’objet : il ne s’agit plus d’aller y enquêter pour dresser la liste des éléments qui permettent de porter cette ligne éditoriale au premier plan, mais de détecter ce qui rend encore possible l’existence de poches d’altérité qui permettent de la combattre, de s’en éloigner ou de s’en protéger. »

Durov aujourd’hui, Zuckerberg, Musk et Tim Cook demain ?

Même si cela demeure impossible à quantifier précisément, il est tout à fait établi que Méta (dans WhatsApp, Messenger, Instagram ou même dans certains groupes Facebook) héberge des activités, des contenus et des échanges tout aussi problématiques et illégaux que ceux hébergés par Telegram. Certains de ces contenus, activités ou échanges ont d’ailleurs et à de nombreuses reprises été documentés dans différentes affaires allant du terrorisme à la pédocriminalité en passant par tout le spectre des crimes et délits possibles. La principale différence c’est que Méta collabore régulièrement avec les autorités là où Dourov est interpellé pour « refus de communiquer » certaines informations ou documents ce qui permet de mobiliser plusieurs autres chefs d’inculpation au titre de « complicité » (encore une fois je ne m’appuie ici que sur les éléments du communiqué de presse du parquet reproduit plus haut dans cet article)

J’ai commencé cet article par vous parler assez longuement de Pavel Dourov. Alors que l’enjeu est en réalité celui de l’usage fait de la plateforme Telegram. Si j’ai beaucoup parlé de son fondateur, c’est parce qu’à l’instar de Must pour X, de Facebook pour Meta, ce qu’est Pavel Dourov, ce à quoi il croit, ce qui l’anime intimement, conditionne également pour une bonne partie ce qu’il laisse se jouer dans sa plateforme.

La vérité c’est que personne, jamais, ne devrait se trouver en situation d’orchestrer un média rassemblant les interactions de plusieurs centaines de millions de personnes.

Pour le reste et sur le fond de l’affaire, Damien Liccia (doctorant au CELSA) en résumait assez bien les interrogations dès le lendemain de l’arrestation :

Si les motifs de l’arrestation de Pavel Durov à Paris sont bien ceux relayés par la presse depuis hier soir se pose donc la question de la pertinence d’une telle approche. Il y a indéniablement des zones d’ombre dans ce dossier, que la naturalisation de Durov par décret en 2021 ne manque pas de rappeler. Faut-il restituer cette arrestation dans le cadre plus global du discours anti-réseaux sociaux qui prévaut à la tête de l’exécutif depuis près de 10 ans ? Est-ce uniquement un rapport de force pour obtenir une backdoor ? Est-ce une question d’ingérence étrangère et informationnelle ? Autant de questionnements donc qui, honnêtement, suscitent plus d’interrogations que de réponses.

One More Thing.

C’est un autre collègue, Kevin Limonnier, qui pointe et résume l’aspect essentiel de cette affaire (lisez l’ensemble du Thread) :

« Dourov a bâti un empire qui connecte aujourd’hui plus de 1 milliard d’être humains. De ce fait, il dispose de ce que l’on appelle en géographie un « pouvoir topologique » immense, c’est à dire qu’il maîtrise un nœud stratégique du cyberespace et en retire un pouvoir considérable. »

Comme l’analysent et le développent encore Louis Pétiniaud et Loqman Salamatian dans leur article partu en 2020 « Le rôle de la topologie d’Internet dans les territoires en conflit en Ukraine, une approche géopolitique du routage des données » :

La puissance topologique est conçue comme une capacité d’agir sur un réseau pour « faire ressentir sa présence » : « ces puissances de longue portée […] sont souvent mieux compréhensibles, non comme des entités s’étendant à travers les frontières et les réseaux, mais plutôt comme un agencement qui permet à des acteurs distants de faire ressentir leur présence, plus ou moins directement, en traversant le fossé entre “ici et là-bas” » (Allen, 2011, p.290)

« Un agencement qui permet à des acteurs distants de faire ressentir leur présence« . Ou plus trivialement de peser dans le game. On ne saurait mieux qualifier l’essence de la médiation qu’inaugurent les plateformes numériques, des réseaux aux médias sociaux en passant par toute la galaxie du Dark Social. Et le pouvoir qu’en retirent leurs dirigeants. Véritables caïds de ces espaces (topos) ils en contrôlent et administrent l’ensemble des discours qui s’y déploient (logos).

S’il n’est pas acceptable de voir enfreint le secret de la correspondance, il ne l’est pas davantage de leur laisser la pure jouissance de ce pouvoir sans qu’ils aient à s’en expliquer devant la loi dès lors que l’on est en mesure de démontrer les atrocités qu’il couvre ou qu’il permet.

[Mise à jour du 6 septembre 2024] Je reproduis ci-dessous la première réaction publique de Pavel Durov sur son compte Telegram (Du Roves’s Channel) en date du 5 septembre 2024 :